Вероятность

И информация

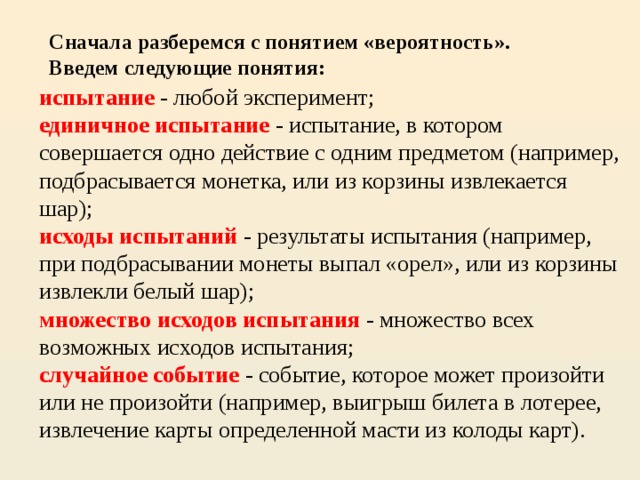

Сначала разберемся с понятием «вероятность». Введем следующие понятия:

испытание - любой эксперимент;

единичное испытание - испытание, в котором совершается одно действие с одним предметом (например, подбрасывается монетка, или из корзины извлекается шар);

исходы испытаний - результаты испытания (например, при подбрасывании монеты выпал «орел», или из корзины извлекли белый шар); множество исходов испытания - множество всех возможных исходов испытания;

случайное событие - событие, которое может произойти или не произойти (например, выигрыш билета в лотерее, извлечение карты определенной масти из колоды карт).

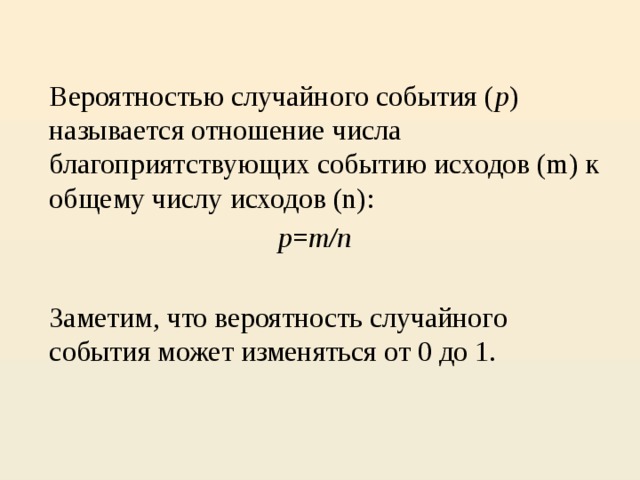

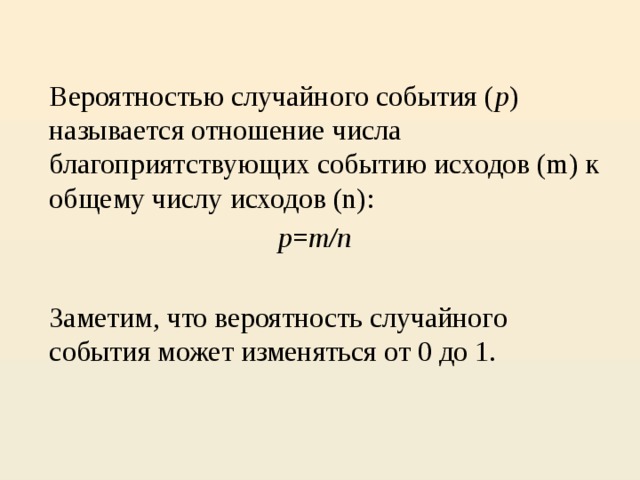

Вероятностью случайного события ( p ) называется отношение числа благоприятствующих событию исходов (m) к общему числу исходов (n):

p = m/n

Заметим, что вероятность случайного события может изменяться от 0 до 1.

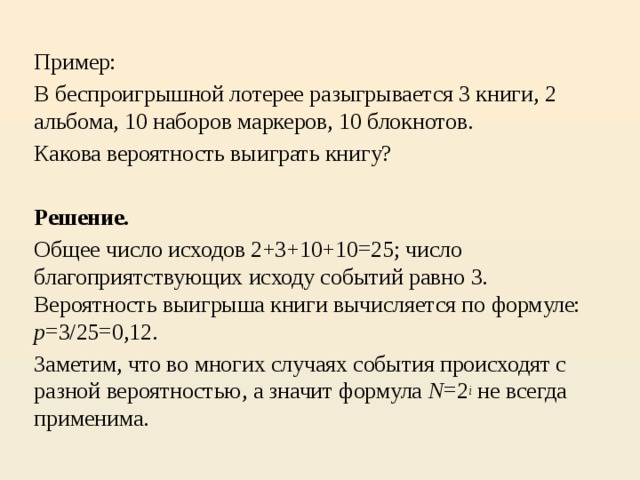

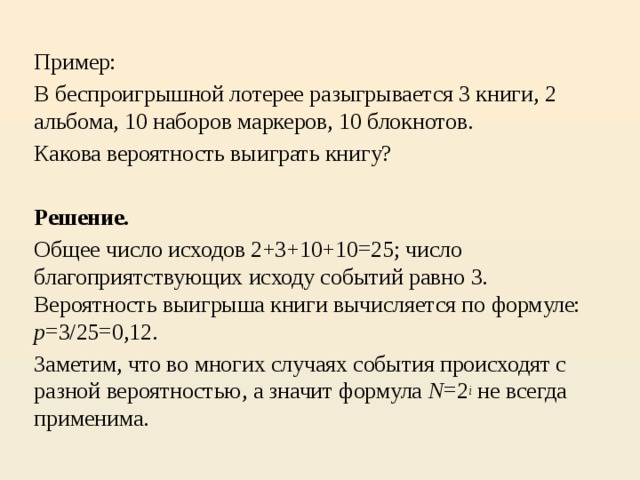

Пример:

В беспроигрышной лотерее разыгрывается 3 книги, 2 альбома, 10 наборов маркеров, 10 блокнотов.

Какова вероятность выиграть книгу?

Решение.

Общее число исходов 2+3+10+10=25; число благоприятствующих исходу событий равно 3. Вероятность выигрыша книги вычисляется по формуле: p =3/25=0,12.

Заметим, что во многих случаях события происходят с разной вероятностью, а значит формула N =2 i не всегда применима.

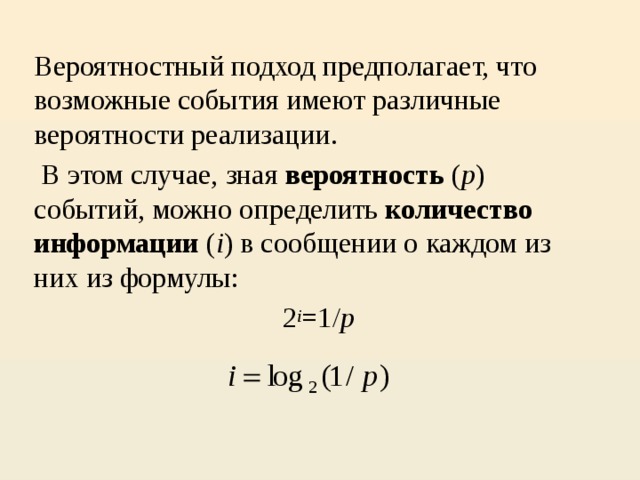

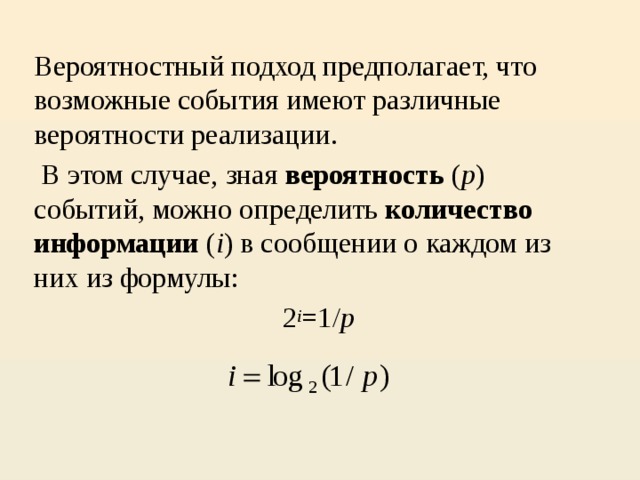

Вероятностный подход предполагает, что возможные события имеют различные вероятности реализации.

В этом случае, зная вероятность ( p ) событий, можно определить количество информации ( i ) в сообщении о каждом из них из формулы:

2 i =1/ p

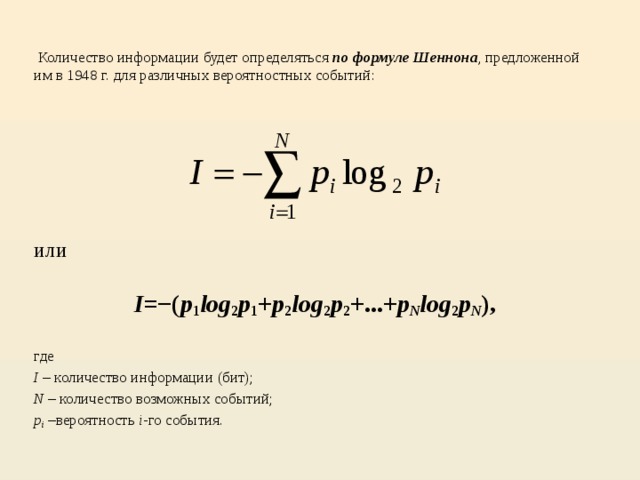

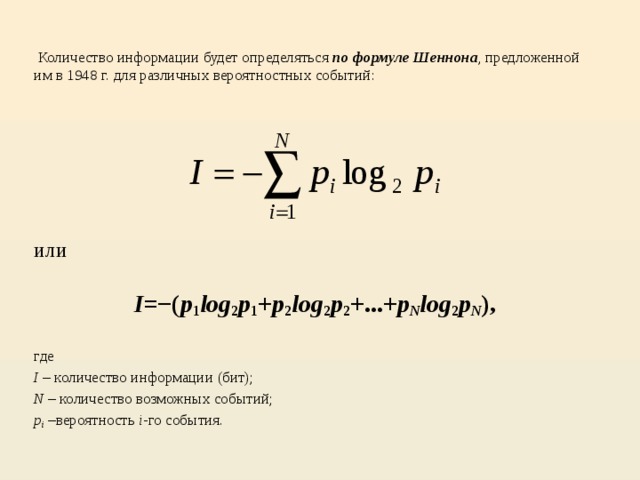

Количество информации будет определяться по формуле Шеннона , предложенной им в 1948 г. для различных вероятностных событий:

или

I =−( p 1 log 2 p 1 + p 2 log 2 p 2 +...+ p N log 2 p N ),

где

I – количество информации (бит);

N – количество возможных событий;

p i –вероятность i -го события.

Качественная связь между вероятностью события и количеством информации в сообщении состоит в следующем: чем меньше вероятность некоторого события, тем больше информации содержит сообщение об этом событии.

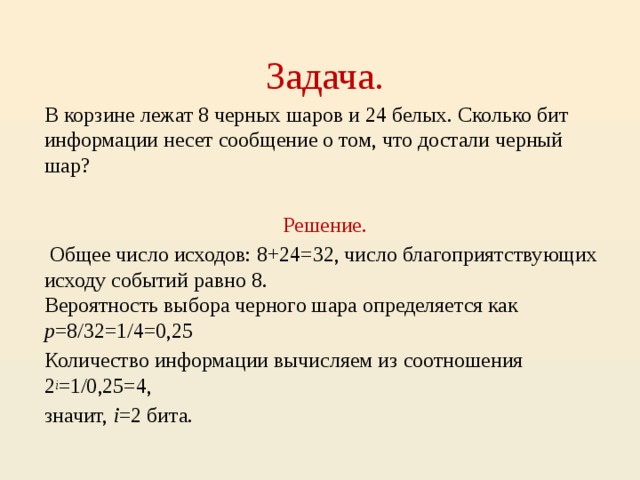

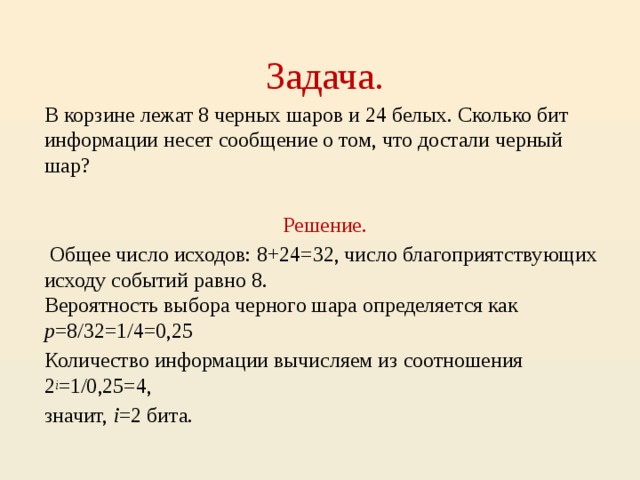

Задача.

В корзине лежат 8 черных шаров и 24 белых. Сколько бит информации несет сообщение о том, что достали черный шар?

Решение.

Общее число исходов: 8+24=32, число благоприятствующих исходу событий равно 8. Вероятность выбора черного шара определяется как p =8/32=1/4=0,25

Количество информации вычисляем из соотношения 2 i =1/0,25=4,

значит, i =2 бита.

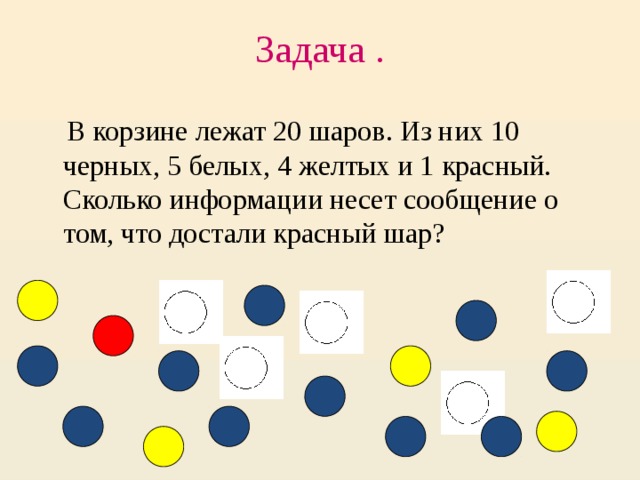

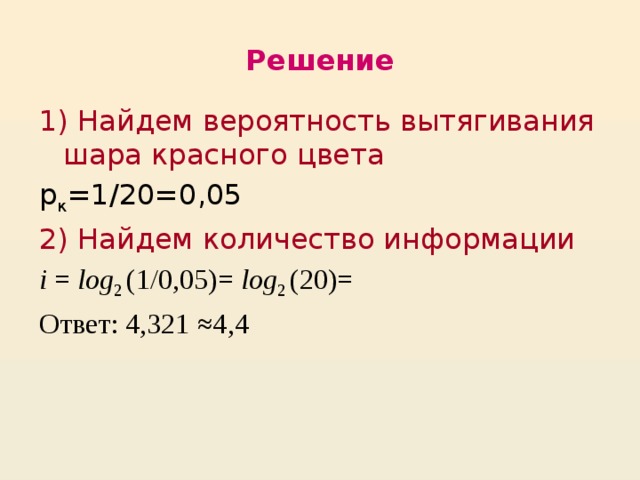

Задача .

В корзине лежат 20 шаров. Из них 10 черных, 5 белых, 4 желтых и 1 красный. Сколько информации несет сообщение о том, что достали красный шар?

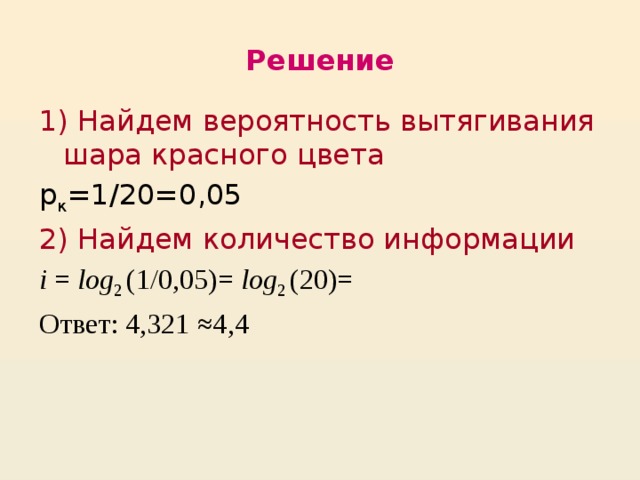

Решение

1) Найдем вероятность вытягивания шара красного цвета

р к =1/20=0,05

2) Найдем количество информации

i = log 2 (1/0,05)= log 2 (20)=

Ответ: 4,321 ≈4,4

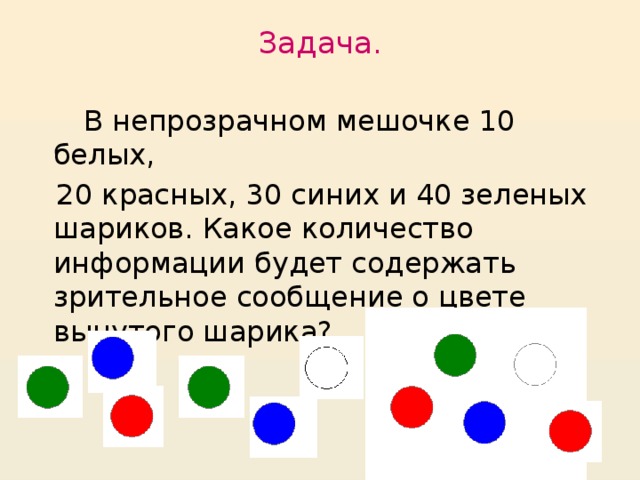

Задача.

В непрозрачном мешочке 10 белых,

20 красных, 30 синих и 40 зеленых шариков. Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика?

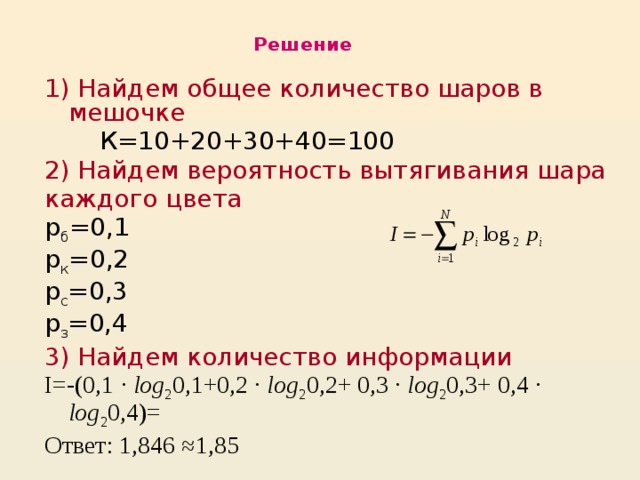

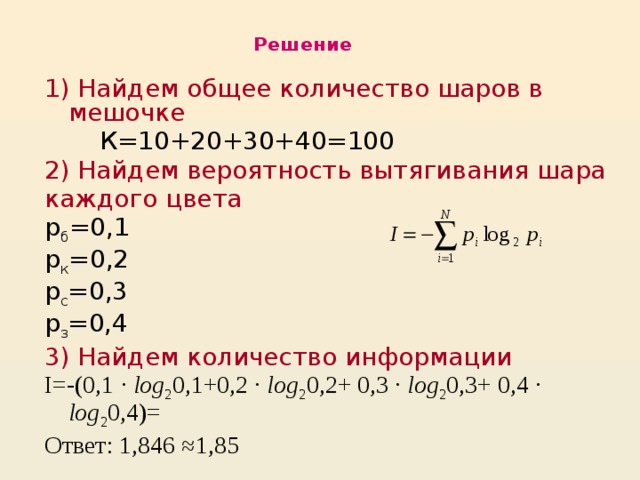

Решение

1) Найдем общее количество шаров в мешочке

К=10+20+30+40=100

2) Найдем вероятность вытягивания шара

каждого цвета

р б =0,1

р к =0,2

р с =0,3

р з =0,4

3) Найдем количество информации

I=-(0,1 · log 2 0,1+0,2 · log 2 0,2+ 0,3 · log 2 0,3+ 0,4 · log 2 0,4)=

Ответ: 1,846 ≈1,85

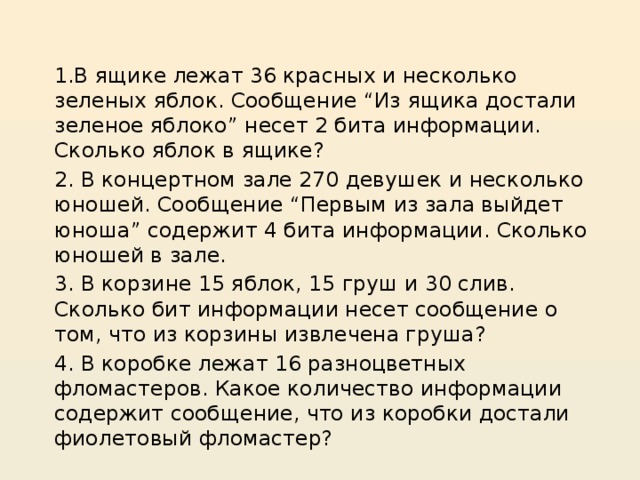

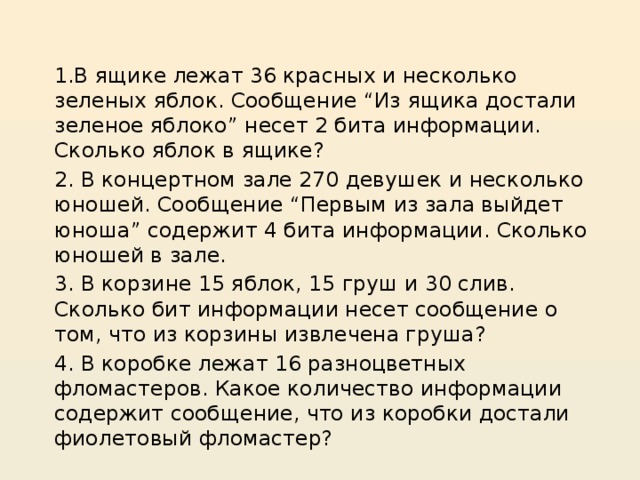

1.В ящике лежат 36 красных и несколько зеленых яблок. Сообщение “Из ящика достали зеленое яблоко” несет 2 бита информации. Сколько яблок в ящике?

2. В концертном зале 270 девушек и несколько юношей. Сообщение “Первым из зала выйдет юноша” содержит 4 бита информации. Сколько юношей в зале.

3. В корзине 15 яблок, 15 груш и 30 слив. Сколько бит информации несет сообщение о том, что из корзины извлечена груша?

4. В коробке лежат 16 разноцветных фломастеров. Какое количество информации содержит сообщение, что из коробки достали фиолетовый фломастер?